Desarrollan una prótesis que traduce las señales cerebrales en palabras

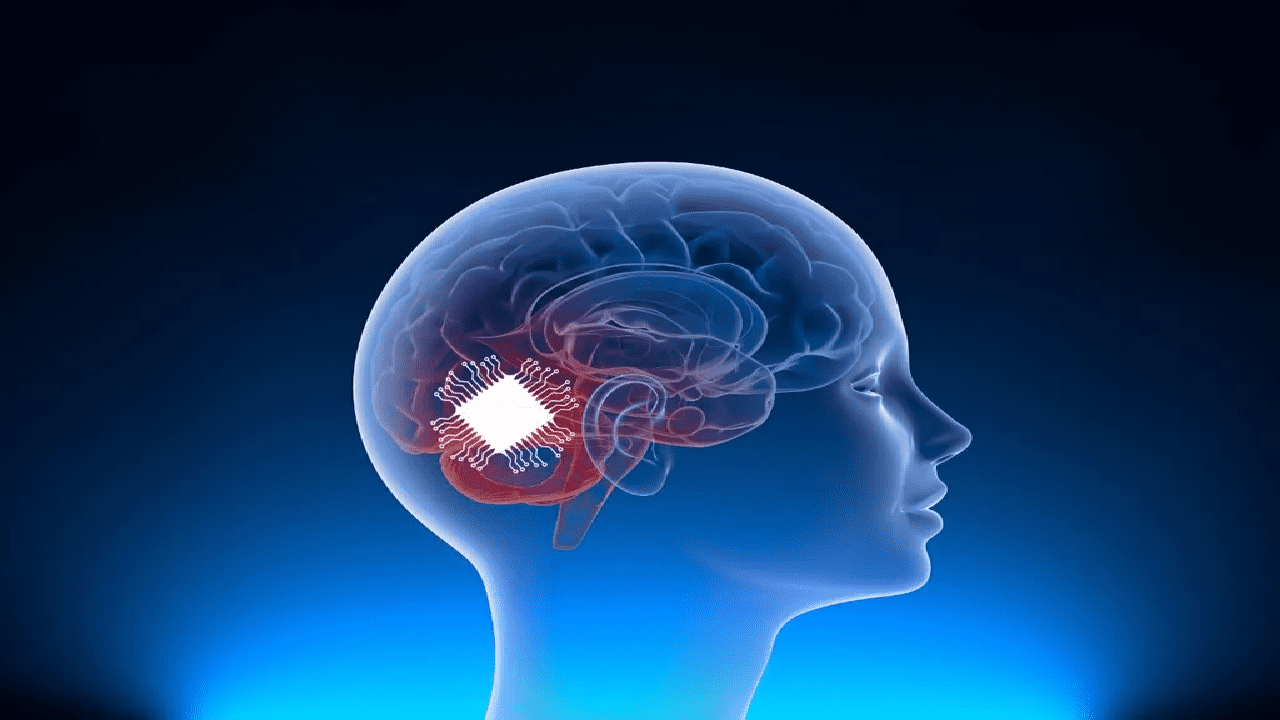

Los científicos han desarrollado una prótesis del habla que puede traducir señales cerebrales en palabras habladas.

El avance, desarrollado por un equipo de investigadores de la Universidad de Duke en Estados Unidos, se presenta en forma de un implante cerebro-computadora y se ha anunciado como un salto extraordinario para la neurociencia.

Se espera que las personas puedan revolucionar la comunicación para quienes padecen trastornos neurológicos que afectan el habla y afecciones como la esclerosis lateral amiotrófica (ELA) o el síndrome de enclaustramiento, ayudándoles a comunicarse sin esfuerzo mediante el implante.

Cogan señaló que las herramientas de decodificación de voz disponibles actualmente son engorrosas y ofrecen una velocidad máxima de aproximadamente 78 palabras por minuto, mientras que el habla humana típica es de alrededor de 150 palabras por minuto. La brecha se debe en gran medida a las limitaciones en la cantidad de sensores de actividad cerebral.

Para abordar esto, Cogan colaboró con Jonathan Viventi, un experto en ingeniería biomédica de Duke, para crear una matriz de sensores cerebrales flexibles, ultradelgados y de alta densidad. Este nuevo sensor, del tamaño de un sello postal, alberga 256 sensores microscópicos, capaces de distinguir la actividad de las neuronas como simples granos de arena.

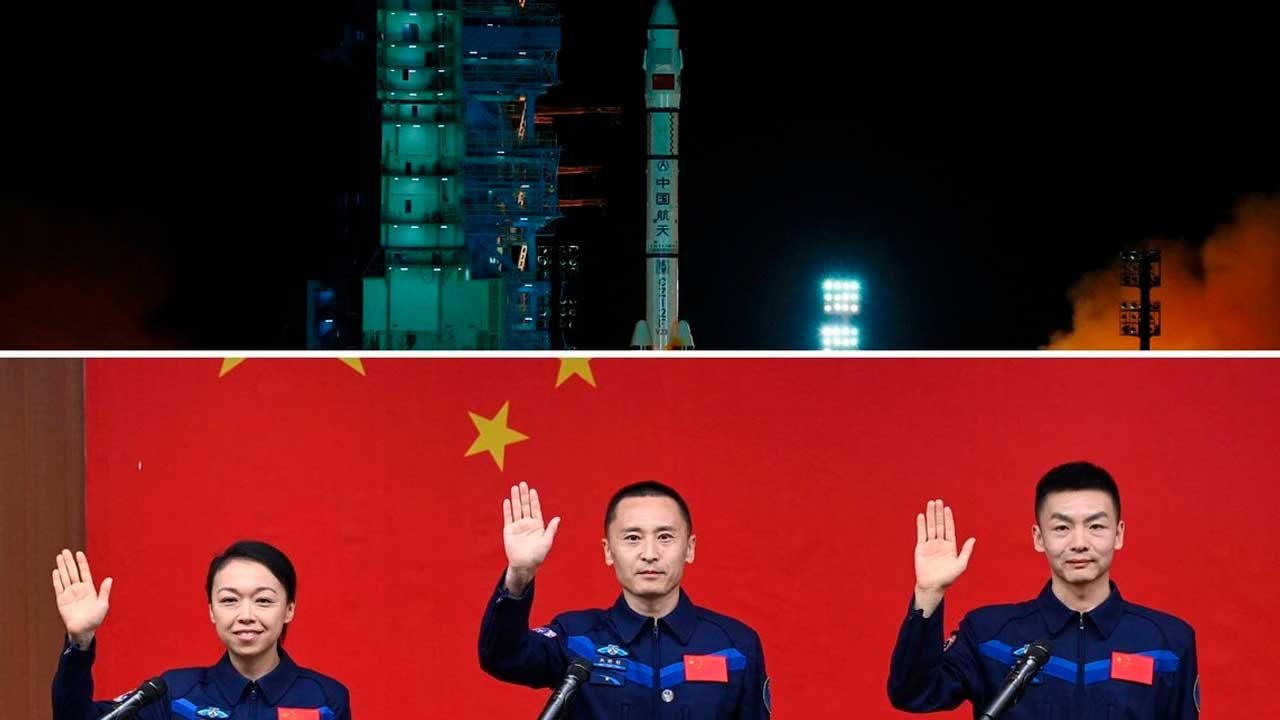

Researchers at Duke University unveil a speech prosthetic translating brain signals into spoken words, offering hope for those with neurological disorders affecting speech. a promising leap in brain-computer interfaces.

— Neolithic Naturals (@NeolithicHealth) November 11, 2023

Read more: https://t.co/OTVvk0rrdd #BrainHealth #Innovation pic.twitter.com/k9QMW7g0Db

La aplicación del equipo en el mundo real implicó una operación rápida, similar a la de un equipo de boxes de NASCAR, en el quirófano. Para el proyecto se reclutaron pacientes sometidos a cirugía cerebral por otras afecciones, como el tratamiento de la enfermedad de Parkinson o la extirpación de tumores.

En un estrecho margen de 15 minutos, los pacientes realizaron una tarea de escuchar y repetir palabras sin sentido, mientras el dispositivo registraba la actividad de la corteza motora del habla de su cerebro.

Luego, el estudio implicó introducir datos neuronales y del habla en un algoritmo de aprendizaje automático. Sorprendentemente, el decodificador demostró una precisión del 84% para ciertos sonidos y una precisión general del 40%. Este impresionante rendimiento se basa en sólo 90 segundos de datos hablados, una mejora significativa con respecto a las tecnologías existentes que requieren períodos de recopilación de datos mucho más largos.

Este prometedor desarrollo avanza gracias a una subvención reciente de los Institutos Nacionales de Salud. En el futuro, el equipo de investigación planea desarrollar una versión inalámbrica del dispositivo para mejorar la movilidad de los usuarios.

Con información de: meteored.mx

CD/NR

Notas del día:

May 30, 2026 / 21:49

Culmina con éxito Primer Estatal de Cachibol en San Andrés Tuxtla

May 30, 2026 / 21:37

Protección Civil de Medellín atiende y controla incendio de pastizal en Puente Moreno

May 30, 2026 / 21:22

Éxito total en el Encuentro Regional de Danzón en Fortín

May 30, 2026 / 21:13

May 30, 2026 / 20:04

El Águila firma a Ríos y Mckenna

May 30, 2026 / 18:35

Trump da marcha atrás en polémica norma para tramitar la "green card"

May 30, 2026 / 18:25

Desisten diputados de Morena de pedir juicio político contra Maru Campos

May 30, 2026 / 17:21

Reitera IMSS Veracruz Norte su compromiso con la población a través del Trato Digno

May 30, 2026 / 15:23

May 30, 2026 / 14:55

Ni géiser ni volcán; especialistas de la UNAM identifican fenómeno ocurrido en Michoacán

May 30, 2026 / 14:46

Xalapa fortalece acciones de prevención y atención para mujeres con Veracruzana Protegida

May 30, 2026 / 14:21

Rosa María: Con respaldo ciudadano y trabajo en territorio, avanza la transformación de Veracruz